RAG (Retrieval-Augmented Generation)

RAG (Retrieval-Augmented Generation): técnica que combina busca em base própria com IA generativa. Veja como funciona e aplicar em WordPress.

RAG retrieval augmented generation é uma técnica de IA que combina recuperação de informação com geração de texto. Em vez de o modelo de linguagem responder apenas com o que aprendeu no treinamento, ele consulta uma base de conhecimento específica antes de gerar a resposta. Aplicado ao WordPress, permite que chatbots, motores de busca e copilotos respondam usando o conteúdo real do seu site, com fontes auditáveis e sem alucinações.

O que é RAG

O nome diz tudo: retrieval (recuperação) + augmented (aumentado) + generation (geração). É uma arquitetura onde um LLM, antes de responder, consulta uma base externa indexada — uma coleção de documentos, artigos, transcrições, manuais — e usa o que encontrou como contexto para a geração. A pergunta do que é RAG ganhou tração em 2023 quando ficou evidente que LLMs puros têm dois problemas crônicos: corte de conhecimento (não sabem nada além da data de treino) e alucinação (inventam fatos com confiança).

RAG resolve os dois. O corte some porque você indexa documentos atuais sob demanda. As alucinações caem porque o modelo é forçado a se ancorar em trechos reais recuperados, com referências rastreáveis. O resultado é uma resposta que cita a fonte e pode ser auditada por quem leu.

O termo retrieval augmented generation foi cunhado em paper da Meta AI Research em 2020. Ganhou popularidade massiva com a chegada do ChatGPT e dos LLMs comerciais, e hoje é a arquitetura padrão para construir aplicações de IA empresariais que precisam responder com base em dados próprios da organização.

É a mesma lógica de um analista experiente: antes de responder, ele abre os arquivos da empresa, lê o que importa e formula a resposta com base no que encontrou. RAG industrializa esse processo dentro de um pipeline de IA.

Como RAG funciona

O fluxo padrão de RAG tem quatro etapas. Primeiro, você indexa os documentos: pega cada artigo, página ou registro, divide em pedaços (chunks), gera um embedding vetorial de cada pedaço com um modelo como OpenAI Ada, Cohere Embed ou um open-source, e guarda esses vetores num banco especializado como Pinecone, Weaviate, Qdrant ou pgvector.

Segundo, na hora da pergunta, você gera o embedding da própria pergunta e busca no banco de vetores os pedaços mais semanticamente próximos. É o passo de retrieval. Terceiro, você monta o prompt final juntando a pergunta original com os trechos recuperados como contexto. Quarto, o LLM gera a resposta usando aquele contexto, idealmente com instruções para citar as fontes e não responder se não houver evidência suficiente.

Existem variantes sofisticadas: hybrid search (vetorial + lexical), reranking (segundo modelo refina a ordem), query rewriting (reescreve a pergunta) e graph RAG (relações entre entidades). Cada camada eleva qualidade em domínios técnicos.

O custo computacional fica dividido. A indexação é feita uma vez (e atualizada quando o conteúdo muda). As consultas são baratas: busca vetorial em milissegundos e chamada ao LLM com tokens proporcionais ao contexto recuperado. Bem desenhado, escala para milhões de consultas mensais.

RAG aplicado ao WordPress

WordPress é uma fonte natural para RAG porque já estrutura conteúdo em posts, páginas, custom post types, taxonomias e campos personalizados. A indexação pode puxar dados via REST API do WordPress ou direto do banco MySQL, percorrer cada conteúdo, dividir em chunks e gerar embeddings sob demanda.

O caso mais comum em rag wordpress é um chatbot que responde dúvidas dos visitantes usando exclusivamente o conteúdo publicado. O bot busca nos artigos do blog, na FAQ, na documentação e nos materiais de apoio, e responde sempre com link para a fonte. Diferente de um chatbot genérico, ele nunca inventa: se a base não cobre o assunto, devolve uma resposta honesta de que não tem informação suficiente.

Quem trabalha com IA generativa no WordPress usa RAG também para gerar resumos automáticos de artigos longos, para criar landing pages combinando trechos de várias fontes internas, e para alimentar motores de busca semânticos que entendem a intenção da pergunta em vez de só casar palavras-chave.

O cuidado fundamental é a engenharia do prompt que orquestra o LLM. Sem instruções explícitas para se ancorar nas fontes, o modelo ainda alucina. Sem critérios de relevância no retrieval, traz trechos irrelevantes que confundem o modelo. RAG não é mágico — é uma arquitetura que precisa ser calibrada com testes reais e métricas de qualidade.

Casos de uso: chatbot, suporte, conteúdo

O caso de uso mais visível é o chatbot de atendimento. Em vez de equipes treinarem um bot de regras frágeis, conectam um RAG à base de FAQs, manuais e tickets antigos. O bot responde com linguagem natural, cita as fontes e escala para o time humano só quando não encontra evidência. Reduz volume de tickets simples e libera atendentes para casos complexos.

No suporte interno, empresas usam RAG sobre documentação técnica e wikis. Um colaborador pergunta como configurar uma integração e o sistema responde com o passo a passo extraído da própria documentação, com link para o documento original. É o que economiza horas de busca em ferramentas como Notion, Confluence ou Google Drive.

No conteúdo, RAG alimenta editores assistidos: o redator escreve um briefing e o sistema sugere parágrafos baseados em artigos anteriores publicados, em pesquisas internas e em transcrições de calls. O ganho é manter consistência de voz e fatuais sem terceirizar a redação ao LLM puro.

Para campos como AEO e geração programática de páginas, RAG vira a infraestrutura que conecta dados internos ao motor de IA, garantindo que o conteúdo gerado tenha base real e citável. É a diferença entre escala vazia e escala com substância.

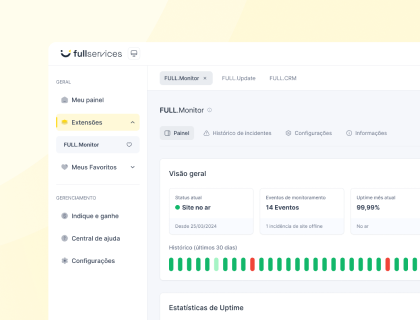

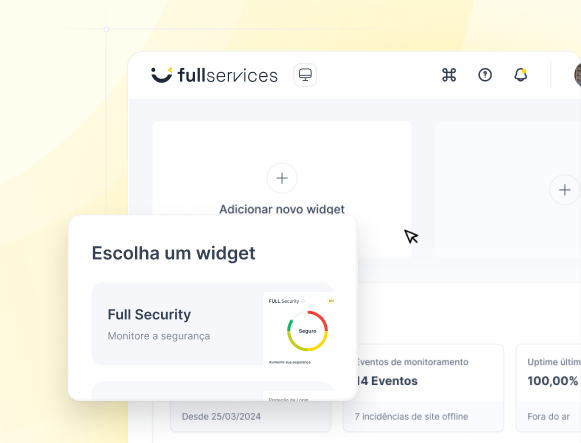

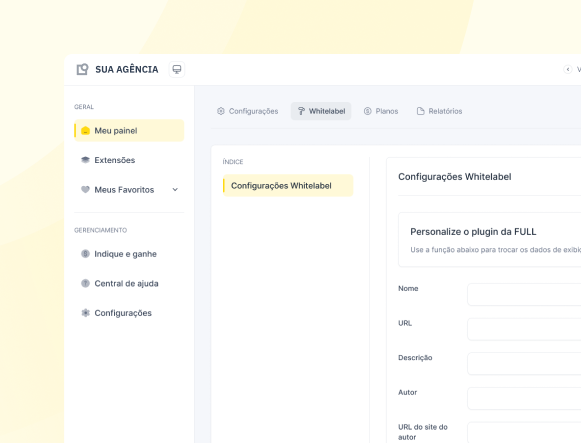

Construir RAG sólido em WordPress depende de fundação técnica adequada: hospedagem com recursos para rodar workers de embedding, banco preparado para escalar e curadoria contínua dos dados indexados. A FULL Services entrega a stack profissional de WordPress com integrações testadas e suporte para projetos que combinam CMS e IA, garantindo que a base esteja pronta para sustentar arquiteturas de RAG sem improviso de infraestrutura.

Termos relacionados

IA Generativa para WordPress

IA generativa WordPress integra GPT, Claude e Gemini ao site para gerar conteúdo, otimizar SEO…

Prompt Engineering

Prompt engineering é a disciplina de criar instruções eficazes para LLMs como ChatGPT e Claude.…

REST API WordPress

REST API WordPress expõe conteúdo do site via JSON. Veja o que é, endpoints principais,…

AEO (Answer Engine Optimization)

AEO Answer Engine Optimization é a otimização para que motores de resposta usem seu conteúdo…