Robots.txt

Robots.txt WordPress instrui o Google sobre o que rastrear no site. Veja sintaxe, exemplos e como configurar sem prejudicar SEO.

Robots.txt WordPress é um arquivo de texto simples na raiz do site que instrui robôs de busca como Google e Bing sobre quais páginas podem ou não rastrear. É a primeira coisa que qualquer crawler legítimo lê ao chegar no domínio. Bem configurado, otimiza o uso do crawl budget e protege áreas internas. Mal configurado, pode tirar o site inteiro do Google e custar meses de tráfego.

O que é o arquivo robots.txt

Robots.txt é um arquivo de texto puro, com o nome literal “robots.txt”, que vive na raiz do domínio. O endereço é sempre seusite.com.br/robots.txt e qualquer pessoa pode ler abrindo essa URL no navegador. Não é segredo nem proteção de segurança: é orientação pública para crawlers.

O padrão foi criado em 1994 pelo engenheiro Martijn Koster e adotado pelos buscadores como convenção informal. Em 2022, o Google e o IETF formalizaram o protocolo em RFC 9309, dando ao robots.txt status de padrão oficial. Antes era acordo de cavalheiros; agora é especificação documentada.

A pergunta sobre o que é robots.txt costuma vir junto com a confusão sobre o que ele realmente faz. O ponto crítico: robots.txt impede crawl, não impede indexação. Se uma URL tem links externos apontando para ela, o Google pode indexá-la mesmo bloqueada no robots.txt. Para realmente tirar uma página do índice, use noindex no meta robots da página, não bloqueio no robots.txt.

Para o WordPress, o arquivo tem papel especial. Sites WordPress têm milhares de URLs geradas automaticamente: arquivos de tag, paginação, busca, feeds. Sem robots.txt orientando o crawler, ele desperdiça tempo em URLs sem valor de SEO em vez de focar nas páginas que importam.

Sintaxe do robots.txt

A sintaxe é minimalista. Cada bloco começa com User-agent (qual crawler a regra se aplica), seguido de uma ou mais diretivas Disallow ou Allow. Linhas em branco separam blocos. Comentários começam com hashtag.

User-agent é o identificador do crawler. “User-agent: *” aplica para todos os crawlers. “User-agent: Googlebot” aplica só ao Google. “User-agent: Bingbot” aplica só ao Bing. Você pode ter blocos diferentes para crawlers diferentes.

Disallow indica que aquele caminho não deve ser rastreado. “Disallow: /wp-admin/” bloqueia toda a pasta administrativa. “Disallow: /privado.html” bloqueia uma página específica. “Disallow: /” bloqueia o site inteiro (cuidado).

Allow é exceção dentro de Disallow. “Disallow: /wp-admin/” seguido de “Allow: /wp-admin/admin-ajax.php” bloqueia a pasta administrativa toda exceto esse arquivo específico, que precisa estar acessível para AJAX funcionar em alguns plugins.

Sitemap aponta para o arquivo XML do site. “Sitemap: https://seusite.com.br/sitemap.xml” diz ao crawler onde encontrar a lista de URLs que você quer indexar. Combine com sitemap XML bem mantido para guiar o Google de forma proativa.

Caracteres especiais incluem asterisco (*, qualquer sequência) e cifrão ($, fim de URL). “Disallow: /*?orderby=” bloqueia qualquer URL com esse parâmetro. “Disallow: /*.pdf$” bloqueia todas as URLs terminadas em .pdf.

Como configurar robots.txt no WordPress

Como criar robots.txt no WordPress tem três caminhos: virtual (gerado pelo WordPress), físico (arquivo real no servidor) e via plugin de SEO.

WordPress gera um robots.txt virtual por padrão. Acesse seusite.com.br/robots.txt e você verá conteúdo padrão básico, mesmo sem nunca ter criado o arquivo. O WordPress monta dinamicamente, com regras genéricas como bloquear /wp-admin/ e permitir admin-ajax.php. Funciona, mas é limitado.

Para customizar, criar arquivo físico na raiz é o caminho clássico. Conecte por FTP/SFTP ao servidor, vá na pasta raiz do WordPress (mesmo nível de wp-config.php), crie um arquivo robots.txt com o conteúdo desejado. A partir desse momento, o WordPress detecta o arquivo físico e para de gerar a versão virtual.

Plugins de SEO oferecem o caminho mais simples. Rank Math, Yoast SEO e All in One SEO têm seção dedicada para editar robots.txt direto pelo painel. Você edita no editor de texto, salva, e o plugin grava no arquivo físico ou na configuração equivalente. Não precisa abrir FTP.

Robots.txt wordpress exemplo bem estruturado para a maioria dos sites: “User-agent: *” no topo, depois “Disallow: /wp-admin/”, “Allow: /wp-admin/admin-ajax.php”, “Disallow: /?s=” (bloqueia busca interna), “Disallow: /*?orderby=” (bloqueia ordenação de WooCommerce), e por fim “Sitemap: https://seusite.com.br/sitemap_index.xml”. Isso cobre os principais ruídos sem prejudicar nada relevante.

Para sites grandes ou complexos, regras adicionais valem. Bloqueio de paginação profunda (Disallow: /page/), de URLs com parâmetros UTM se gerarem versões duplicadas, de archive de autor em sites onde isso não importa. Combine com sitemap XML e Google Search Console para guiar o crawler.

Erros comuns que afetam SEO

Erro número um: bloquear o site inteiro acidentalmente. “Disallow: /” sem Allow específico tira todas as páginas do crawl. Acontece quando alguém deixa o site em desenvolvimento com bloqueio total e esquece de remover ao publicar. WordPress tem opção “Desencorajar mecanismos de busca de indexar este site” que injeta exatamente isso. Sempre verifique antes de subir para produção.

Erro número dois: bloquear arquivos críticos. CSS e JavaScript precisam ser rastreáveis para o Google entender o layout da página. Bloquear /wp-content/themes/ ou /wp-includes/ inteiro impede o Googlebot de renderizar a página corretamente, e o ranqueamento sofre. Hoje, plugins modernos não recomendam mais bloquear esses caminhos.

Erro número três: confiar em robots.txt para esconder página privada. Já vimos: robots.txt impede crawl, não indexação. Página com link externo pode aparecer no Google mesmo bloqueada. Para realmente esconder, combine noindex (na meta da página) com proteção por senha ou login obrigatório.

Erro número quatro: sintaxe errada. Falta de espaço entre User-agent e o nome, vírgulas em vez de quebras de linha, comentários no meio de regra. Crawlers ignoram diretivas malformadas, então o efeito esperado não acontece. Use o testador de robots.txt do Google Search Console para validar.

Erro número cinco: bloquear URL que tem backlinks. Se uma página antiga tem links de outros sites apontando para ela, bloquear no robots.txt pode fazer perder a autoridade. O melhor é deixar o Google rastrear, e se for desnecessária, marcar como noindex ou redirect 301 para a nova versão.

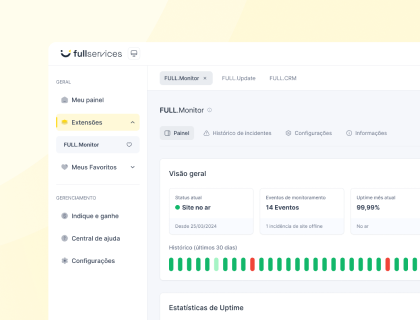

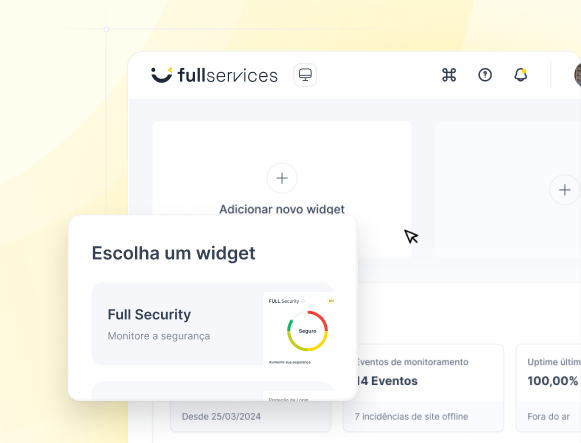

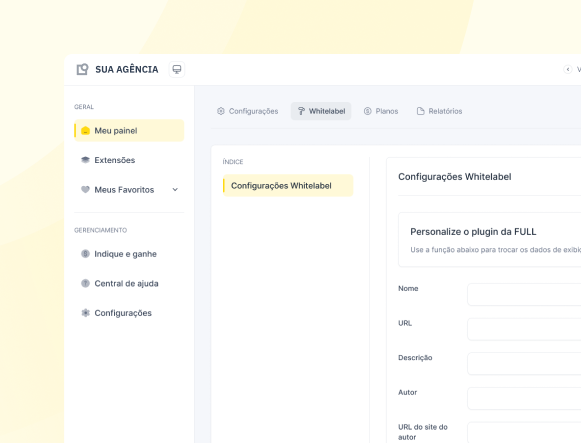

Para sites profissionais que precisam dessa camada de SEO técnico bem ajustada sem revisão manual constante, a FULL Services entrega o Rank Math já licenciado e configurado dentro da stack profissional, com editor de robots.txt embutido, monitoramento de URLs bloqueadas e auditoria automática de regras. Em vez de o cliente abrir FTP toda vez que precisa ajustar uma regra, faz tudo direto pelo painel WordPress.

Termos relacionados

Sitemap XML

Sitemap XML wordpress lista todas as URLs do site para Google e bots de IA.…

Google Search Console

Google Search Console WordPress mostra como o site aparece no Google e monitora indexação. Veja…

Indexação

Indexação WordPress é o processo do Google adicionar suas páginas ao índice de busca. Veja…

Crawl Budget

Crawl budget WordPress é o limite de páginas que o Google rastreia no seu site…