Embeddings

Embeddings IA são vetores numéricos que representam texto e capturam significado. Veja como funcionam, busca semântica e aplicações WordPress.

Embeddings IA são representações numéricas de palavras, frases, parágrafos ou documentos inteiros como vetores de centenas ou milhares de dimensões. O modelo aprende a posicionar conteúdos similares próximos no espaço vetorial: “plugin de cache” e “acelerador de WordPress” terão vetores parecidos, mesmo sem compartilhar palavras. Essa propriedade matemática é a base de busca semântica, sistemas de recomendação, RAG (Retrieval-Augmented Generation) e da maior parte dos casos de uso modernos de LLMs aplicados a conteúdo.

O que são embeddings

Tecnicamente, um embedding é um array de números reais. Um modelo como text-embedding-3-small da OpenAI gera vetores de 1.536 dimensões. Um modelo da Cohere gera 1.024. Um da Voyage AI pode gerar 2.048. Cada dimensão é uma coordenada em um espaço de alta dimensionalidade, e cada texto vira um ponto nesse espaço.

O modelo é treinado de forma que distância entre dois vetores reflita similaridade semântica. Vetores próximos representam textos com significado parecido. Vetores distantes, textos sobre temas diferentes. “Carro” e “automóvel” caem perto. “Carro” e “banana” caem longe. A distância é calculada normalmente via cosine similarity ou produto interno.

O que são embeddings, no fluxo prático, é a forma de transformar texto em algo que máquinas comparam por significado, não por correspondência de palavra. Busca por keyword retorna só páginas que contêm exatamente o termo digitado. Busca por embedding retorna páginas que falam do mesmo assunto, mesmo com palavras diferentes.

O conceito vem da NLP clássica (Word2Vec, GloVe), mas explodiu em 2022-2023 com modelos LLM. Hoje, OpenAI, Cohere, Voyage, Anthropic e modelos open source como BGE e E5 entregam embeddings de alta qualidade via API ou rodando localmente. O custo caiu para frações de centavo por mil tokens.

Como embeddings funcionam

O modelo de embedding é uma rede neural treinada em volumes gigantes de texto. Durante o treinamento, ele aprende a mapear texto para vetor de tal forma que pares de texto relacionados (ex.: pergunta e resposta, título e parágrafo, frase em inglês e tradução) caem próximos no espaço.

Para usar, você manda o texto para a API, recebe o vetor e armazena junto com o conteúdo original. “O que é cache no WordPress” → vetor de 1.536 números. “Cache armazena cópias temporárias do site” → outro vetor. Cosine similarity entre os dois retorna um número entre -1 e 1: quanto mais perto de 1, mais relacionados.

O custo é baixo. text-embedding-3-small da OpenAI custa cerca de US$ 0.02 por milhão de tokens. Indexar 10 mil artigos de 500 palavras roda em alguns dólares. Modelos open source como BGE-M3 podem rodar localmente sem custo de API, com performance competitiva.

Os vetor embeddings ficam guardados em vector databases como Pinecone, Weaviate, Qdrant, Chroma, ou em extensões como pgvector para PostgreSQL e Supabase. Esses bancos são otimizados para busca por proximidade em alta dimensão (ANN — approximate nearest neighbor), com latência de milissegundos para milhões de vetores.

Embeddings em busca semântica

O caso clássico é busca semântica em base de conteúdo. O usuário digita “como deixar meu site mais rápido”. O sistema gera o embedding da query, compara com os embeddings de todos os artigos indexados, e retorna os 5 mais próximos. O artigo “Cache WordPress: como funciona” aparece mesmo sem conter exatamente as palavras da busca.

O salto de qualidade em relação à busca por keyword tradicional é grande. SQL com LIKE ou Elasticsearch puro retornam só matches literais. Embedding semântica entende que “deixar mais rápido” e “acelerar” e “performance” estão falando do mesmo assunto.

Em e-commerce, embeddings ajudam recomendação. Cliente comprou um produto: gere o embedding da descrição, busque produtos com embedding próximo, recomende. Funciona melhor que recomendação por categoria fixa, especialmente para catálogos grandes onde categorização manual fica imprecisa.

Em chatbots e suporte, embeddings são a base do RAG. O sistema indexa toda a base de conhecimento como vetores. Quando o usuário faz uma pergunta, busca os trechos mais relevantes via embedding, monta o contexto e passa para o LLM gerar a resposta. Combine com RAG para entender o pipeline completo.

Aplicações no WordPress

Busca interna inteligente é o caso de uso mais imediato. Plugins e SaaS como Algolia AI Search, Searchanise e soluções customizadas usando OpenAI embeddings + pgvector entregam busca semântica no WordPress que devolve resultados relevantes mesmo com query mal redigida ou em outra língua.

Recomendações de conteúdo são o segundo caso. “Quem leu este artigo também leu” baseado em similaridade de embedding bate “baseado em tag” porque captura nuances que a taxonomia manual perde. Para portais de conteúdo e blogs com centenas de artigos, o ganho de retenção é mensurável.

Conexão com GEO é estratégica. LLMs como ChatGPT e Perplexity usam embeddings internamente para decidir quais fontes citar em respostas. Conteúdo bem estruturado, com parágrafos enxutos e definições claras, gera embeddings mais distinguíveis e tem mais chance de ser recuperado como fonte. AEO e GEO são, no fundo, batalhas por embedding bem posicionado.

Integração via REST API é o caminho técnico. Um plugin custom WordPress pode interceptar publicação de post, gerar embedding via OpenAI ou Voyage, e armazenar em pgvector na base do WordPress ou em vector database externo. Combine com REST API WordPress e com IA generativa para montar fluxos de busca, sumarização e Q&A automáticos sobre o conteúdo do site.

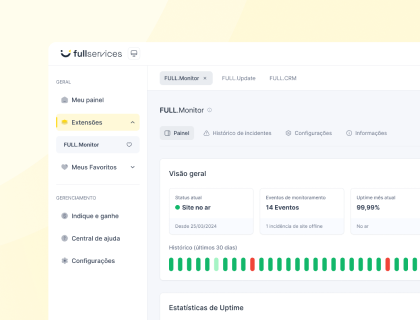

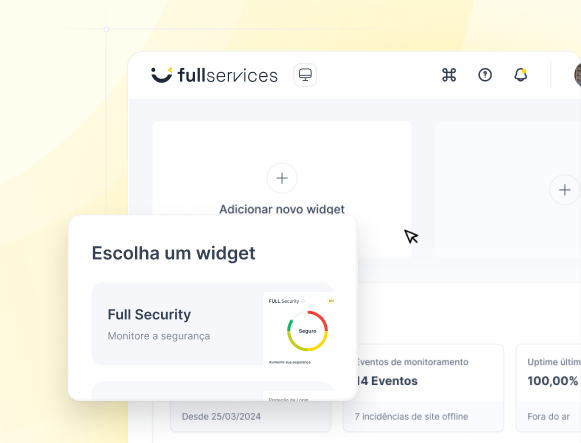

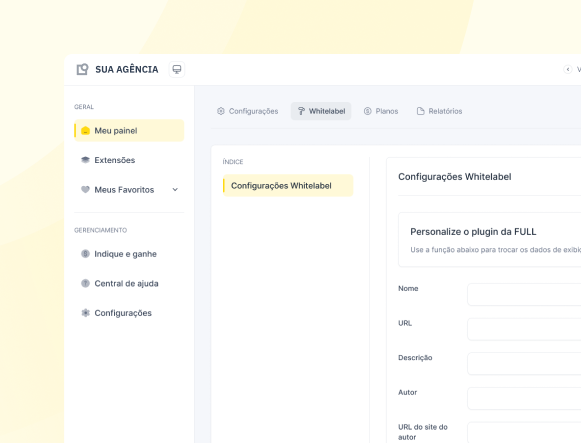

Para times que querem aplicar embeddings semântica em sites WordPress sem montar a stack do zero, a FULL Services apoia projetos de IA aplicada a conteúdo dentro da stack profissional WordPress, com integrações pré-validadas a OpenAI, Anthropic e bancos vetoriais. É a forma de levar busca semântica e RAG ao site sem virar especialista em vector databases primeiro.

Termos relacionados

RAG (Retrieval-Augmented Generation)

RAG (Retrieval-Augmented Generation): técnica que combina busca em base própria com IA generativa. Veja como…

IA Generativa para WordPress

IA generativa WordPress integra GPT, Claude e Gemini ao site para gerar conteúdo, otimizar SEO…

REST API WordPress

REST API WordPress expõe conteúdo do site via JSON. Veja o que é, endpoints principais,…

GEO (Generative Engine Optimization)

GEO Generative Engine Optimization é otimização para que ChatGPT, Perplexity e Gemini citem seu site…